Gli elementi essenziali delle rivoluzioni informatiche e ambientali alle quali stiamo assistendo vanno gioca forza incrociate con la grande incognita dell’intelligenza artificiale, la cui gestione comporta attente riflessioni etiche.

La transizione digitale e la transizione ecologica sono temi fortemente interconnessi e richiedono riflessioni non superficiali. Se sviluppate correttamente, ma non è propriamente semplice, entrambe comportano indubbi miglioramenti nella qualità della vita personale e del contesto sociale.

La transizione digitale può migliorare l’efficienza delle organizzazioni e delle comunicazioni, facilitare i processi di apprendimento, mettere a disposizione quantità gigantesche di conoscenza a un costo quasi gratuito, a qualunque ora del giorno e della notte, in qualsiasi luogo e in qualunque condizione. Ma come tutti ormai sanno, internet è come l’aquila bicipite degli Asburgo, con un’ala che rappresenta i rischi e un’altra che ne sottolinea le opportunità. Appunto per questo, volendo utilizzare questa condizione inedita nella storia dell’uomo, bisogna innanzi tutto essere consapevoli.

Quando parliamo di transizione digitale dobbiamo necessariamente tenere conto della sicurezza informatica, che dovrebbe essere una materia da insegnare obbligatoriamente nelle scuole, a partire dalla prima elementare. E questo non solo per difendersi dai rischi, ma soprattutto per cogliere le straordinarie opportunità che la Rete consente. Stando attenti ai pericoli, si individuano le informazioni credibili, le fonti rilevanti e diventa possibile avvicinarsi alla sempre difficile comprensione della realtà.

Quindi, transizione digitale significa diffusione di conoscenza e di consapevolezza, anche ambientale. Le premesse culturali di questa trasformazione sono state poste negli anni Sessanta da una serie di intellettuali, guidati dall’italiano Aurelio Peccei, che avevano definito “i limiti dello sviluppo”. Con la costituzione, nei primi anni Settanta, del “Club di Roma”, aperto ai contributi di scienziati e umanisti, economisti e politici, uomini d’affari ed esponenti della società civile, le contraddizioni legate alla crescita sono diventate evidenti. Non a caso, big dell’hi-tech, come Elon Musk e Jeff Bezos, hanno cominciato a investire nello spazio, individuandolo come una opportunità di business, non solo per la space economy, ma anche a livello turistico e per insediamenti umani stabili.

Parimenti, anche la transizione ecologica pone temi giganteschi, come la riconversione dei processi produttivi e la riduzione delle energie tradizionali, con l’ulteriore sviluppo delle energie rinnovabili, che pur contribuendo alla decarbonizzazione, non possono sostituire totalmente l’energia tradizionale. Secondo me, occorre riflettere presto anche su soluzioni controverse come la possibilità dell’uso del nucleare. Il nostro Paese lo ha vietato con un referendum, ma contemporaneamente acquista energia nucleare da centrali di Paesi che hanno impianti posti ai nostri confini.

Pertanto, il nucleare potrebbe rappresentare, in condizioni di assoluta sicurezza, una scelta obbligata. Non a caso, Enrico Mattei aveva già individuato in questa forma di produzione di energia una prospettiva di sviluppo fondamentale per il nostro Paese. Negli anni Sessanta con la costruzione della centrale di Latina, l’Italia era il terzo Paese più sviluppato a livello nucleare per usi pacifici nel mondo, dopo gli Stati Uniti e il Regno Unito.

Credo che transizione ecologica e digitale siano temi strategici, che vanno esaminati senza lenti ideologiche e pregiudizi, ma unendo i punti, utilizzando il metodo dell’intelligence che serve per individuare le fonti affidabili e le informazioni rilevanti, contestualizzandole adeguatamente e velocemente.

In pratica, occorre esercitare il pensiero contrario per ridurre la complessità del reale. È importante allora cercare di capire gli elementi essenziali, che vanno poi tutti ovviamente incrociati con la grande incognita dell’intelligenza artificiale. I cui esiti, nel confronto con l’intelligenza umana, ancora non è in grado di conoscere nessuno. Le opinioni sull’intelligenza artificiale sono controverse. Federico Faggin nel suo ultimo libro, “Irriducibile. La coscienza, la vita, i computer e la nostra natura”, sostiene che l’intelligenza umana non potrà mai essere superata da quella artificiale. Mentre Alan Turing nel 1950 a chi gli chiedeva se i computer potessero essere in futuro dotati di coscienza rispose di sì. Come si vede, posizioni totalmente opposte.

Personalmente ritengo che, in un certo senso, la questione sia mal posta. Il problema non è se l’intelligenza artificiale superi o meno quella umana, ma se l’intelligenza artificiale possa svolgere meglio alcune funzioni rispetto a quella umana. Secondo me questo già avviene in tantissimi campi, tra cui alcuni di quelli più rilevanti. Per esempio, nelle applicazioni in medicina. Chi ha detto che il medico non potrà mai essere sostituito da una macchina? Se noi sottoponiamo in visione la nostra cartella clinica a un algoritmo, questo riesce a individuare la nostra patologia con un’accuratezza superiore al 90%, contro circa il 50% di quanto riesce a fare un medico in carne e ossa. E ricordiamo pure che nel 2021 le prime cause di morte negli Stati Uniti d’America sono state in primis le malattie cardiache, le seconde il cancro e le terze gli errori medici. Allora, serve o non serve l’intelligenza artificiale in sanità?

L’intelligenza artificiale sarà fondamentale anche per la cyber security, che è tutta intelligenza artificiale, un tema di cui oggi in tanti discutono, ma, secondo me, in Italia, sono ancora pochi quelli che conoscono in modo approfondito l’argomento. Se l’intelligenza artificiale sarà lo strumento di base per le transizioni digitale ed ecologica, cyber sicurezza compresa, non sarà comunque indolore per i costi, che saranno anche umani, perché potrebbe creare una consistente disoccupazione.

Norberto Bobbio affermava che negli anni si era affermata una “coscienza nucleare”, nel senso dell’acquisita consapevolezza delle conseguenze dell’utilizzo dell’ordigno. Appunto per questo, sebbene Israele disponga dell’atomica, non la userà contro Hamas e la Russia non lo farà contro l’Ucraina, perché si comprende bene che, nelle estreme conseguenze, potrebbe comportare la scomparsa del genere umano. Di contro, allo stato non abbiamo affatto sviluppato una consapevolezza delle conseguenze dell’uso dell’intelligenza artificiale. Con una differenza radicale: la bomba atomica è in mano agli Stati, mentre l’intelligenza artificiale è in mano prevalentemente ai privati. Questo cambia tutto. Infatti, se i possessori dell’intelligenza artificiale avessero una visione che non va al di là delle loro personali esistenze, assumendo di fatto il punto di vista sintetizzato da Giorgio Caproni nei versi “morto io, morto Dio”, potremmo davvero stare tranquilli?

____________________________________________________

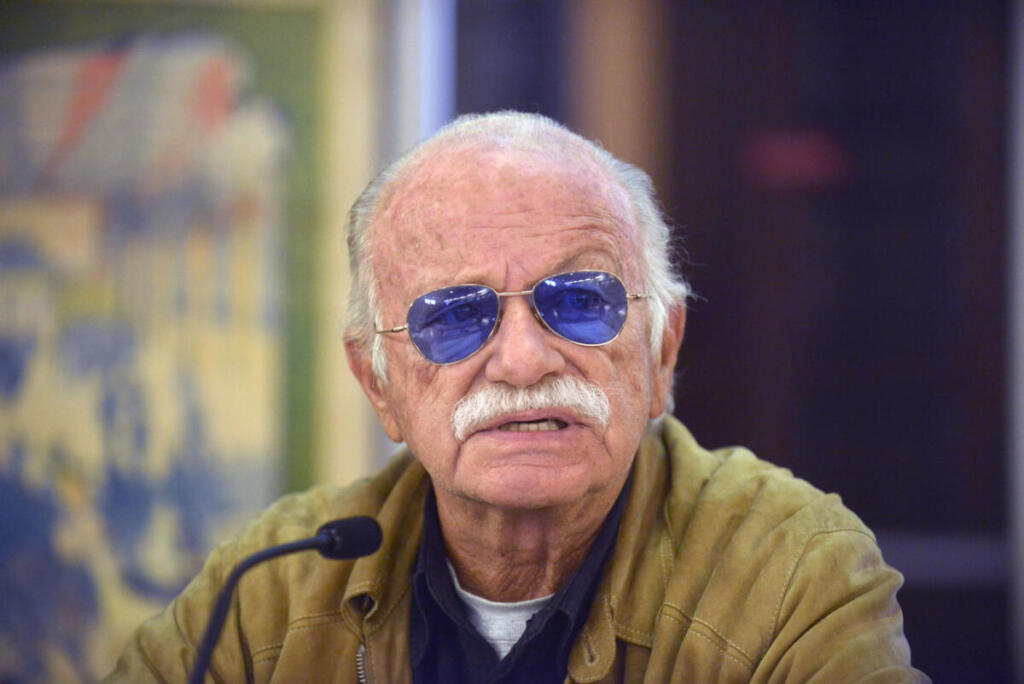

Mario Caligiuri è Professore ordinario di pedagogia della comunicazione all’Università della Calabria, dove dirige il Master in Intelligence e il Laboratorio in Intelligence ed è presidente della Società Italiana di Intelligence. Autore della voce “intelligence” nella “Enciclopedia Italiana” della Treccani, è considerato uno dei massimi studiosi europei di intelligence a livello accademico.